谷歌的张量处理器(TPU)是如何工作的?

2016年3月,DeepMind的AlphaGo击败围棋世界冠军李世石,这在人工智能领域具有里程碑式的意义。而这场比赛所使用的硬件,谷歌已经投入生产运行一年多,但从未公开承认过。

张量处理单元(TPU)的意义远不止于一款高速芯片。它标志着计算理念的根本性转变:有时少即是多。

自 2015 年以来,谷歌的 TPU 系列芯片已发展了七代,从最初处理图像识别查询的单芯片扩展到如今拥有 9216 个芯片的超级计算机,用于训练目前规模最大的语言模型。本文将探讨谷歌为何要打造定制芯片,以及其工作原理,并揭示他们必须面对的物理限制和工程权衡。

对TPU的需求

2013年,谷歌的基础设施团队进行了一项计算。如果安卓用户像谷歌预期的那样大规模使用语音搜索,即使每天只使用三分钟,其计算需求也需要谷歌将其全球数据中心的规模扩大一倍。

当时这个问题似乎没有明显的解决方案。建造更多配备传统处理器的数据中心在经济上不可行。更重要的是,摩尔定律多年来一直在放缓。几十年来,半导体行业一直依赖于晶体管密度大约每两年翻一番的观察结果,从而在不改变架构的情况下实现性能的持续提升。然而,到了2013年,这种趋势开始减弱。谷歌不能仅仅等待英特尔的下一代CPU来解决它的问题。

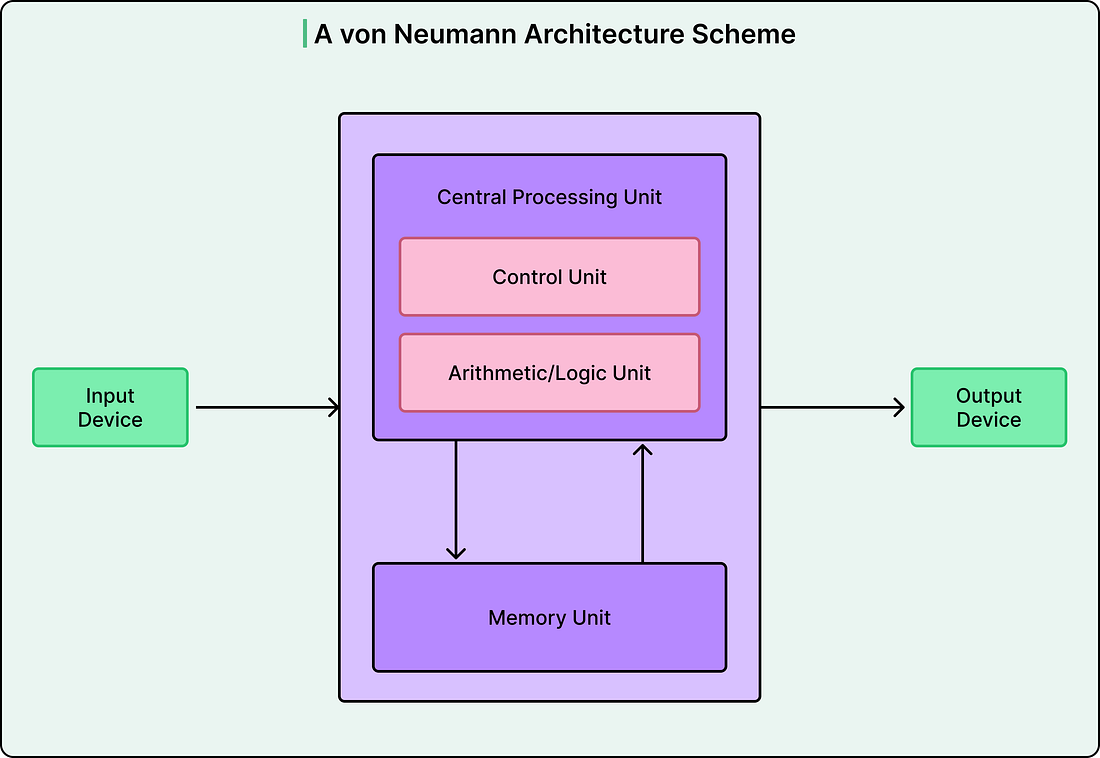

造成这种情况的根本原因在于架构。传统计算机遵循冯·诺依曼架构,其中处理器和内存通过共享总线进行通信。要执行任何计算,CPU 必须先获取指令,然后从内存中检索数据,执行运算,最后将结果写回内存。处理器和内存之间这种持续不断的信息传输,造成了计算机科学家所说的冯·诺依曼瓶颈。